Bolla IA? La prossima ondata è nella robotica

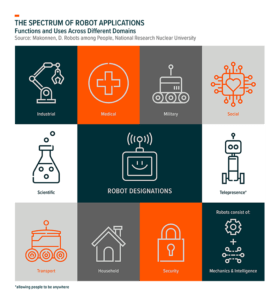

L’intelligenza artificiale ha dominato i titoli dei giornali per la sua creatività e la capacità di generare testi, immagini e codice. Tuttavia, la prossima ondata di trasformazione potrebbe non essere digitale, bensì fisica. La robotica rappresenta l’incarnazione fisica dell’IA, in cui gli algoritmi vengono dotati di braccia, gambe e sensori per agire nel mondo reale. Questa fusione tra intelligenza e macchine sta avvenendo più rapidamente del previsto: i costi stanno diminuendo, le capacità aumentando e interi settori si stanno trasformando. Il tema della robotica sta passando insomma da una visione di lungo termine a una realtà imminente.

I progressi nei modelli Visual-Language-Action (VLA) esemplificano questo cambiamento, conferendo ai robot la capacità di percepire l’ambiente in tre dimensioni, distinguere oggetti non uniformi e applicare la giusta quantità di forza nella manipolazione dei materiali. Il robot Vulcan di Amazon rappresenta una possibile svolta nell’automazione dei magazzini, andando oltre velocità e destrezza per avvicinarsi a qualcosa di più umano: la capacità di percepire. A differenza delle precedenti macchine “sorde e cieche”, Vulcan utilizza bracci robotici della divisione Universal Robots di Teradyne, che integrano sensori tattili avanzati e sistemi di feedback della forza. Questi permettono al robot di valutare la pressione, regolare la presa e gestire oggetti irregolari o delicati senza danneggiarli. In combinazione con i modelli VLA, Vulcan può ora eseguire operazioni di prelievo e stoccaggio un tempo considerate quasi impossibili da automatizzare.

Nel settore delle tecnologie mediche, Intuitive Surgical Inc. continua a essere leader nella chirurgia robotica assistita con il suo sistema chirurgico da Vinci 5, che offre ai chirurghi informazioni in tempo reale per migliorare la precisione e l’efficienza in interventi complessi. L’indicatore di forza misura la pressione esercitata dagli strumenti robotici durante l’operazione, fornendo ai chirurghi un feedback tattile per prevenire danni ai tessuti e migliorare la precisione in procedure delicate. L’azienda ha inoltre mostrato le capacità di telerobotica, consentendo ai chirurghi di operare a distanza e mettendo in luce il crescente potenziale degli interventi chirurgici connessi di nuova generazione.

La trasformazione della robotica, da macchine pre-programmate a sistemi adattivi e intelligenti, è guidata dall’integrazione di software di IA, edge computing avanzato e sensori evoluti. Nvidia si trova al centro di questa evoluzione: il suo stack robotico ha attirato oltre due milioni di sviluppatori e supporta oggi più di 7mila clienti aziendali. L’azienda ha recentemente introdotto la piattaforma Jetson Thor, pensata per robot umanoidi e industriali, che offre un insieme completo di soluzioni: dai modelli di IA generativa ad ambienti di simulazione come Isaac. L’ecosistema Nvidia comprende oltre 150 partner tra hardware, software e sensori, fornendo una soluzione “full-stack” chiavi in mano per gli sviluppatori di robotica.

Parallelamente, l’innovazione nei sensori sta ampliando le capacità dei robot. Il Light Detection and Ranging (LiDAR) è una tecnologia di rilevamento che emette impulsi laser, misura il tempo di ritorno della luce e utilizza questi dati per costruire mappe tridimensionali precise dell’ambiente, consentendo ai robot di percepire distanze, forme, ostacoli e terreni. LiDAR e altre tecnologie di percezione avanzata permettono alle macchine di mappare, navigare e interagire con ambienti complessi in tempo reale, aprendo nuove applicazioni nelle infrastrutture intelligenti, nella mobilità autonoma e nei contesti industriali.

Forse lo sviluppo più sorprendente nella robotica odierna è la rapidità con cui si avvicina la diffusione degli umanoidi. Considerati fino a poco tempo fa una prospettiva lontana, gli umanoidi potrebbero conoscere un’adozione significativa, sia industriale che domestica, entro i prossimi tre o quattro anni. Questa accelerazione è alimentata dall’IA incarnata – l’applicazione di LLM, apprendimento rinforzato e IA generativa a macchine fisiche – unita al calo dei costi e ai primi impieghi industriali. Le piattaforme umanoidi di base stanno già raggiungendo prezzi inferiori ai 20.000 dollari, aprendo la strada a un’adozione più ampia.

La startup 1X, guidata dal roboticista Bernt Børnich, ha introdotto il suo umanoide NEO, un assistente domestico in grado di passare l’aspirapolvere, annaffiare le piante e offrire compagnia. Børnich descrive NEO come parte di una visione in cui i robot assistenti si occupano delle mansioni di routine, liberando le persone per attività a maggiore valore aggiunto. Anche Unitree Robotics sta favorendo una diffusione più ampia dei robot umanoidi con i modelli G1, venduto a 16.000 dollari, e R1, a 5.900 dollari. Il G1 offre 23 gradi di libertà per movimenti complessi come camminare, saltare e manipolare oggetti, mentre l’R1 rappresenta un prodotto più accessibile e conveniente.

Con il passaggio degli umanoidi dalle fabbriche alle case, le implicazioni economiche vanno oltre la produttività. I fornitori di infrastrutture cloud e di gestione dei dati trarranno vantaggio dall’aumento della domanda di modelli di IA personalizzati per umanoidi destinati ai consumatori, generando una forte crescita nella richiesta di capacità di calcolo e di archiviazione. Gli investitori possono guardare anche ai principali abilitatori – dai sensori ai sistemi IoT e agli strumenti di machine learning – che potenziano le capacità degli umanoidi.

Con l’aumento del reshoring e la crescente scarsità di manodopera, la robotica sta emergendo come una leva fondamentale per la produttività e la competitività. Per gli investitori, ciò significa infine che investire nella robotica non è solo una scommessa sull’automazione, ma sull’ascesa dell’“IA fisica” come tecnologia determinante del prossimo decennio.

VIDEO INTERVISTE

VIDEO INTERVISTE Motori

Motori REAL ESTATE

REAL ESTATE LMF crypto

LMF crypto

LMF food

LMF food LMF private markets

LMF private markets LMF arte

LMF arte Legal

Legal LMF green

LMF green