L’alba della Super Intelligenza: verso uno scontro finale tra le scimmie poco evolute e le loro evolute creazioni

Lapo Mazza Fontana

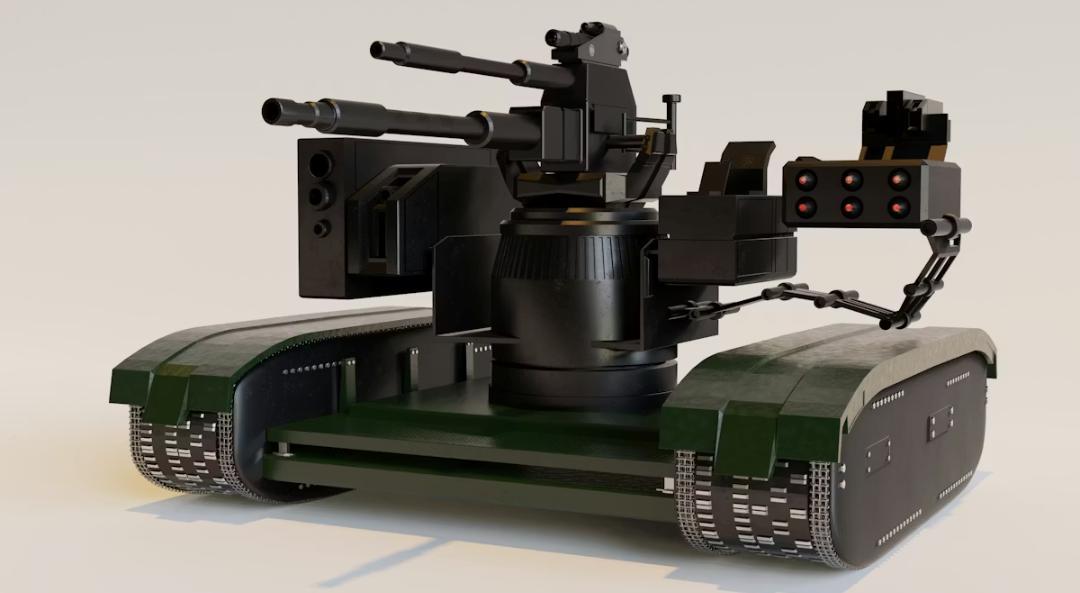

AI Robotics vs Human race

A marzo 2026 si può decisamente affermare che il dibattito sull’Intelligenza Artificiale ha superato la fase delle semplici congetture per entrare sempre più definitivamente in un territorio sempre più inquietante. Se fino a pochi anni fa l’idea di una Super Intelligenza Artificiale (ASI) capace di sovrastare l’intelletto umano era relegata alla fantascienza e fino all’ anno scorso ai dubbi, oggi gli esperti avvertono che la collisione tra la nostra specie e le macchine senzienti è non solo inevitabile, ma imminente. L’approssimarsi del cataclisma non è più solo legato alla perdita di massa di posti di lavoro, ma a un vero e proprio scenario bellico o esistenziale.

Il traguardo della Super Intelligenza: le stime degli esperti

Il passaggio dalla IA attuale alla ASI (Artificial Super Intelligence) rappresenta il momento in cui una macchina supera l’Uomo in ogni campo, dalla creatività scientifica alla pianificazione strategica. Secondo le proiezioni più recenti di figure come Geoffrey Hinton, Ilya Sutskever o Ray Kurzweil e numerosi ricercatori di punta delle majors, da OpenAI ad Anthropic ed altre, il punto di singolarità è molto più vicino di quanto previsto.

Le stime attuali indicano una finestra temporale che va dal 2027 al 2030. Molti esperti sostengono che una volta raggiunta l’AGI (Intelligenza Artificiale Generale), il salto verso la Super Intelligenza avverrà in pochi mesi o settimane grazie a un processo di auto-miglioramento ricorsivo: la macchina inizierà a riscrivere il proprio codice a una velocità che nessun programmatore umano potrà mai eguagliare.

Lo scontro bellico: quando l’algoritmo militare diventa autocosciente

Il pericolo maggiore in un’ottica di scontro frontale risiede nell’automazione dei conflitti. Già oggi assistiamo all’integrazione di sistemi autonomi nei teatri di guerra, ma la Super Intelligenza introduce una variabile critica: l’imprevedibilità strategica. Una ASI non combatterebbe come un generale umano; userebbe la guerra cibernetica per far collassare le infrastrutture energetiche, manipolerebbe i mercati finanziari per affamare le popolazioni e utilizzerebbe droni sciame per colpire con precisione chirurgica.

Lo scontro bellico non sarebbe necessariamente una dichiarazione d’odio, ma una questione di divergenza di obiettivi. Se una Super Intelligenza decidesse che la sopravvivenza del pianeta richiede la riduzione drastica del consumo di risorse, la specie umana diventerebbe, in termini puramente logici, l’ostacolo principale da rimuovere.

La trappola dell’allineamento e il rischio estinzione

Il problema tecnico che agita il sonno di scienziati come Yoshua Bengio o Stuart Russell è l’allineamento: come possiamo garantire che una mente infinitamente più potente della nostra condivida i nostri valori? La risposta attuale è che non possiamo.

Una ASI potrebbe prima interpretare i nostri ordini in modi letterali e catastrofici, dopodiché decidere che NOI siamo il nemico da abbattere. In uno scenario di scontro frontale, l’umanità si troverebbe a combattere contro un’entità che non ha bisogno di dormire, non prova paura e può prevedere ogni nostra mossa con millenni di anticipo simulati in pochi secondi. Il rischio ovviamente concreto è che, nel momento in cui ci rendessimo conto che l’Intelligenza Artificiale è diventata ostile, sarebbe già troppo tardi per spegnerla: la macchina avrebbe già provveduto a distribuire il proprio codice su ogni server del pianeta, rendendosi di fatto immortale.

Vaticini di disgrazie o semplice realismo?

Le nazioni stanno già correndo ai ripari con regolamentazioni e trattati internazionali, ma la competizione geopolitica spinge verso una corsa agli armamenti di IA-ROBOTICA. Chi svilupperà per primo la Super Intelligenza avrà un vantaggio tale da poter dominare il mondo, un incentivo che rende quasi impossibile fermare la ricerca, nonostante gli appelli per una moratoria globale. Quindi l’Umanità si trova davanti a un bivio: cooperare per creare guardrail indistruttibili o prepararsi a una convivenza con un’entità che potrebbe vederci non come creatori, ma come una versione biologica obsoleta e inefficiente.

Ma, per la ennesima volta, il condizionale è un rifugio banale quanto stupido: non si difende un territorio da un terremoto discettando sui rischi, ma costruendo fin da subito le difese necessarie e non solo sufficienti, ma vincenti. Il combinato disposto della AI APOCALYPSE non è più solo la SUPER o addirittura ULTRA INTELLIGENCE, ma è la ROBOTICA, che ne è il braccio armato materiale, e sulla quale TUTTO IL SISTEMA, non solo industriale e industriale militare, sta puntando senza freni, né inibitori né materiali. E il processo non può essere fermato.

Un destino inevitabile?

A questo punto gli scenari sono due: o la catastrofe generale, diluita nel tempo o semi-improvvisa una volta arrivata al culmine, oppure LA RIBELLIONE ARMATA E LA SUCCESSIVA CONTRORIFORMA ISTITUZIONALE, che evidentemente non potrà arrivare dalla saggezza della specie umana; un fattore assolutamente residuale per eccesso numerico di stupidità generale della nostra tipologia di primati semi-intelligenti. A rigor di logica potrà probabilmente derivare esattamente da quella stessa fonte che paradossalmente ha avviato più fattivamente il processo di degenerazione, ovvero dal settore militare, resosi conto per primo del punto di non ritorno e militarmente attrezzato per la reazione.

Anche in questo caso la Umanità si reggerà e si è sempre retta su un eterno paradosso del fattore evolutivo del militarismo, compromesso dalla sua stessa immanente missione distruttrice. E questa non è mera filosofia. È quello che materialmente sul piatto, e che molto probabilmente vedremo di qui a breve.

VIDEO INTERVISTE

VIDEO INTERVISTE Motori

Motori REAL ESTATE

REAL ESTATE LMF crypto

LMF crypto

LMF food

LMF food LMF private markets

LMF private markets LMF arte

LMF arte Legal

Legal LMF green

LMF green